Mengenal Explainable AI, Si Penjelas di Balik Teknologi Pintar!

Source: Gemini AI

Source: Gemini AI

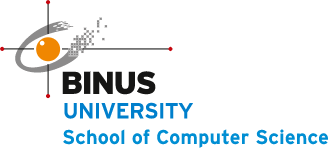

Pernahkah terlintas rasa bingung bagaimana sebuah sistem kecerdasan buatan (AI) bisa menebak sesuatu dengan begitu tepat? Mulai dari rekomendasi film hingga deteksi penyakit, AI bekerja sangat cepat—bahkan kadang terasa seperti “kotak hitam”. Explainable AI hadir untuk menjelaskan apa yang sebenarnya terjadi di balik layar, dengan cara yang lebih manusiawi dan mudah dipahami oleh siapa pun.

Apa Itu Explainable AI?

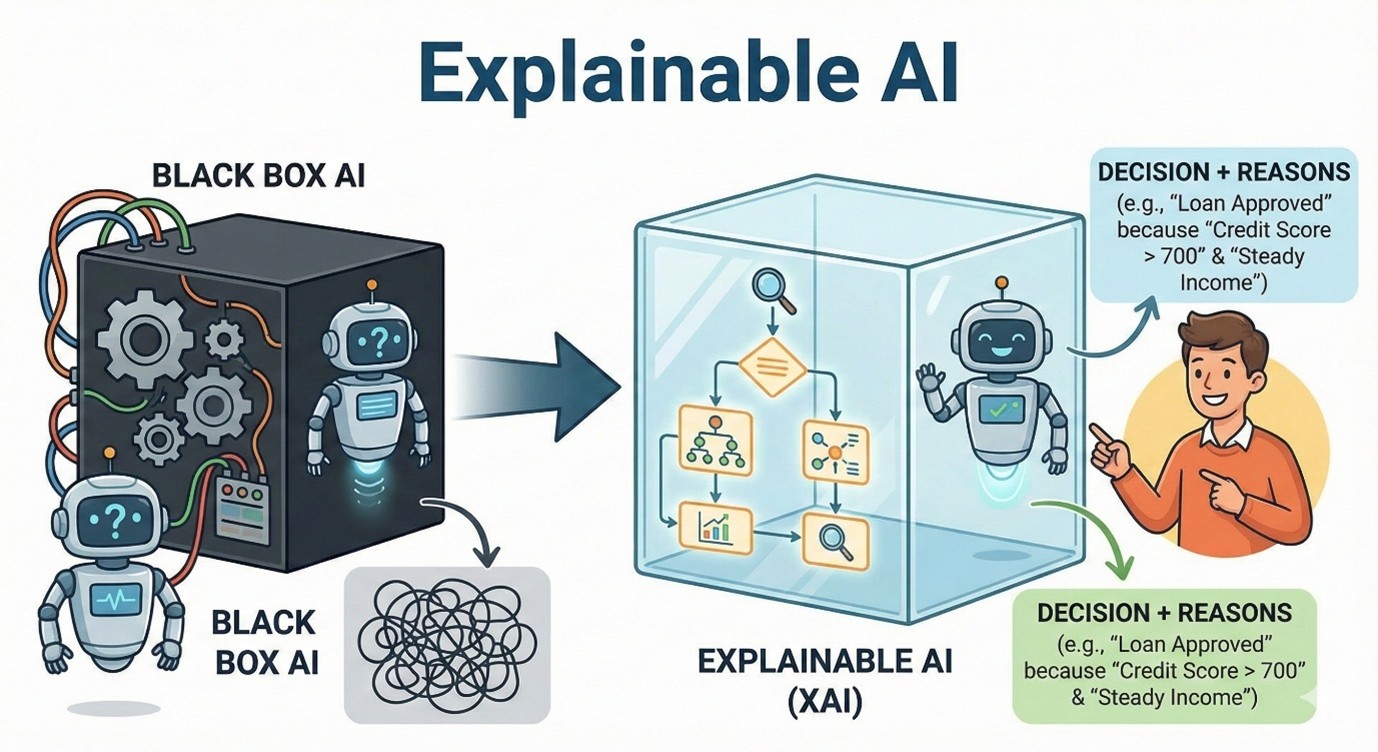

Explainable AI (atau XAI) adalah pendekatan yang membuat keputusan AI lebih transparan, mudah dijelaskan, dan dapat dipahami manusia.

Tujuannya sederhana: agar setiap orang tahu mengapa AI mengambil keputusan tertentu, bukan hanya menerima hasilnya begitu saja.

Contoh mudahnya:

Jika sebuah sistem AI menentukan bahwa suatu email adalah spam, XAI akan memberikan alasan di balik keputusan tersebut, misalnya “karena terdapat kata promo mencurigakan” atau “alamat pengirim tidak terpercaya”.

Source: Gemini AI

Mengapa Explainable AI Penting?

Penggunaan AI semakin meluas dalam kehidupan sehari-hari. Tanpa penjelasan yang jelas, pengguna bisa merasa ragu atau tidak percaya.

Beberapa alasan utama XAI sangat penting:

- Meningkatkan kepercayaan pengguna. Keputusan menjadi lebih mudah diterima jika alasan di baliknya dapat dipahami.

- Membantu mendeteksi kesalahan AI. Jika terjadi keputusan yang tidak wajar, penyebabnya bisa dilihat dengan jelas.

- Lebih adil dan transparan. Terutama untuk bidang sensitif seperti kesehatan, keuangan, dan proses rekrutmen.

- Memenuhi regulasi. Banyak regulasi global kini menuntut agar sistem AI mampu memberikan penjelasan yang masuk akal.

Bagaimana Cara Explainable AI Bekerja?

Walaupun tekniknya terlihat rumit, konsep dasar XAI cukup mudah dicerna. Umumnya, XAI bekerja dengan cara:

- Menyoroti faktor paling berpengaruh dalam keputusan AI.

- Menunjukkan bagian data yang memiliki peran besar.

- Menyediakan visualisasi sederhana, seperti grafik atau area yang disorot.

- Memberikan penjelasan singkat, misalnya “fitur A menaikkan nilai, fitur B menurunkannya”.

Metode populer yang sering dipakai:

- LIME: Menjelaskan keputusan AI dengan menyoroti bagian data yang paling berpengaruh.

- SHAP: Menghitung kontribusi setiap fitur secara lebih terukur.

XAI dapat dianggap sebagai “penerjemah” yang mengubah bahasa kompleks AI menjadi penjelasan yang mudah dipahami manusia.

Source: Gemini AI

Contoh Penggunaan Explainable AI di Kehidupan Nyata

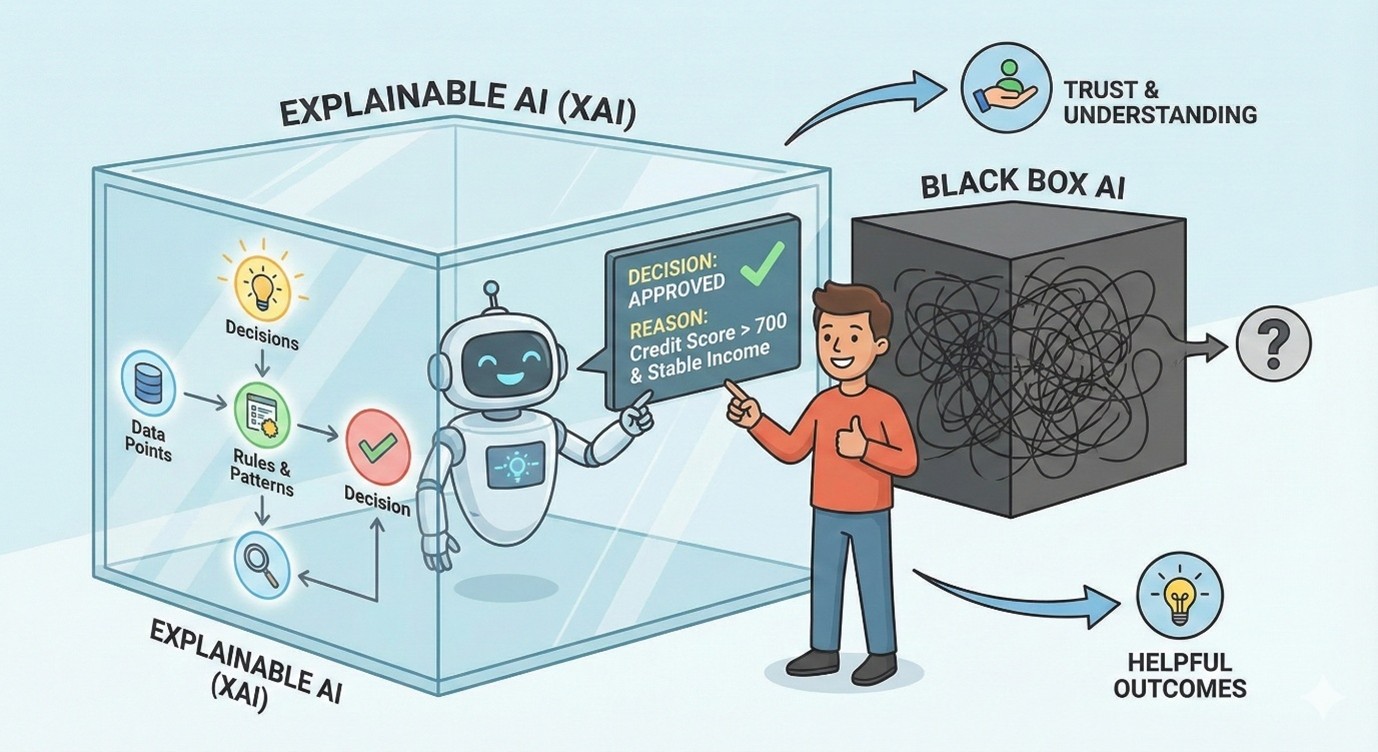

- Kesehatan

AI mampu membaca hasil rontgen untuk mendeteksi penyakit.

Dengan XAI, tenaga medis bisa melihat bagian mana yang dianggap bermasalah oleh AI, sehingga keputusan lebih akurat dan aman bagi pasien.

- Keuangan

Dalam penilaian kredit, XAI dapat menjelaskan faktor apa saja yang membuat permohonan seseorang disetujui atau ditolak.

Hal ini membantu menciptakan proses yang lebih adil dan transparan.

- Media Sosial & Rekomendasi

Ketika muncul rekomendasi video atau produk tertentu, XAI bisa memberikan penjelasan sederhana seperti:

“Konten ini mirip dengan yang sebelumnya ditonton.”

Penjelasan semacam ini membantu pengguna merasa lebih nyaman dan memahami alasan rekomendasi diberikan.

Apa Tantangan Explainable AI?

Walaupun memiliki banyak manfaat, XAI juga menghadapi beberapa tantangan:

- Sistem AI modern sangat kompleks, sehingga tidak selalu mudah dijelaskan secara sederhana.

- Penjelasan harus akurat, namun tetap mudah dipahami oleh banyak kalangan.

- Ada algoritma tertentu yang sifatnya terlalu “misterius” sehingga sulit dijelaskan tanpa mengorbankan performa.

Explainable AI membantu menjadikan kecerdasan buatan lebih jelas, manusiawi, dan transparan. Dengan XAI, keputusan tidak hanya disajikan begitu saja, tetapi juga disertai alasan yang mudah dimengerti. Di tengah perkembangan teknologi yang semakin pesat, penjelasan yang masuk akal bukan lagi sekadar pilihan—melainkan kebutuhan penting agar AI tetap aman dan dapat dipercaya.

Referensi Artikel

- DARPA – Explainable Artificial Intelligence (XAI)

Program riset resmi DARPA yang menjadi dasar pengembangan konsep XAI modern.

(Dokumentasi dan publikasi awal terkait tujuan dan pendekatan XAI.) - Ribeiro, Marco Tulio; Singh, Sameer; Guestrin, Carlos. (2016).

“Why Should I Trust You? Explaining the Predictions of Any Classifier.”

Paper yang memperkenalkan metode LIME, salah satu teknik XAI paling populer. - Lundberg, Scott M.; Lee, Su-In. (2017).

“A Unified Approach to Interpreting Model Predictions.”

Paper yang memperkenalkan metode SHAP, metode berbasis teori Shapley values. - Doshi-Velez, Finale; Kim, Been. (2017).

“Towards A Rigorous Science of Interpretable Machine Learning.”

Referensi fundamental terkait definisi dan arah penelitian interpretabilitas AI. - Molnar, Christoph. (2022).

“Interpretable Machine Learning: A Guide for Making Black Box Models Explainable.”

Buku (free online) yang sangat populer untuk memahami konsep XAI dengan bahasa mudah. - Guidotti, Riccardo; Monreale, Anna; Ruggieri, Salvatore et al. (2018).

“A Survey of Methods for Explaining Black Box Models.”

Studi komprehensif yang merangkum berbagai teknik XAI. - Adadi, Amina; Berrada, Mohammed. (2018).

“Peeking Inside the Black-Box: A Survey on Explainable Artificial Intelligence (XAI).”

Survey lengkap terkait perkembangan XAI dan aplikasinya di berbagai sektor. - Gunning, David; Aha, David W. (2019).

“DARPA’s Explainable Artificial Intelligence Program.”

Pembahasan lanjutan mengenai program XAI dan dampaknya pada riset AI modern.

Keyword Utama

- Explainable AI

- XAI

- Transparansi AI

- Interpretabilitas AI

- AI yang dapat dijelaskan

- Kecerdasan buatan

Informasi Penulis:

Reinert Yosua Rumagit, S.Kom., M.T.I.