Apa Itu Hugging Face dan Kenapa Semakin Penting di Era AI?

Sumber: Hugging Face

Di tengah gelombang revolusi Artificial Inteligence / kecerdasan buatan yang semakin cepat, satu nama yang terus muncul dalam berbagai diskusi teknologi, khususnya AI adalah Hugging Face. Platform ini telah menjadi fondasi penting dalam perkembangan model AI, khususnya lagi dalam konteks Large Language Models (LLM). Hugging Face bukan hanya sekadar library Python, Hugging Face kini menjadi ekosistem terbuka yang menjembatani antara komunitas open-source, dunia akademik, hingga dunia industri.

Hugging Face pertama kali dikenal luas berkat library transformers, yaitu sebuah toolkit yang memudahkan siapa saja untuk menggunakan model NLP canggih seperti BERT, RoBERTa, GPT-2, dan hingga kini sudah banyak sekali model-model AI yang dikembangkan dan dapat digunakan secara umum. Berkat pendekatan API yang intuitif dan dokumentasi yang lengkap, Hugging Face membuat penggunaan model AI tidak lagi eksklusif untuk kalangan dengan latar belakang machine learning mendalam.

Mengapa Hugging Face Jadi Tulang Punggung Komunitas AI

Tanpa Hugging Face, proses menggunakan LLM bisa sangat rumit: kamu harus menemukan modelnya di repositori GitHub acak, menyesuaikan arsitektur jaringan, melakukan tokenisasi dan rangkaian processing secara manual, hingga menangani proses inference secara manual. Hugging Face menyederhanakan semua itu. Seperti dijelaskan dalam blog resmi Hugging Face, misi mereka adalah “demokratisasi AI,” memastikan bahwa tools dan model AI yang canggih tersedia bagi siapa saja.

Platform ini juga mendorong kolaborasi terbuka. Siapa saja bisa mengunggah model, dataset, atau demo AI mereka ke Hugging Face Hub, dan membagikannya dengan komunitas global. Banyak model open-source seperti LLaMA, Falcon, dan Mistral dirilis secara resmi melalui Hugging Face, menjadikannya pusat distribusi model AI terbesar saat ini.

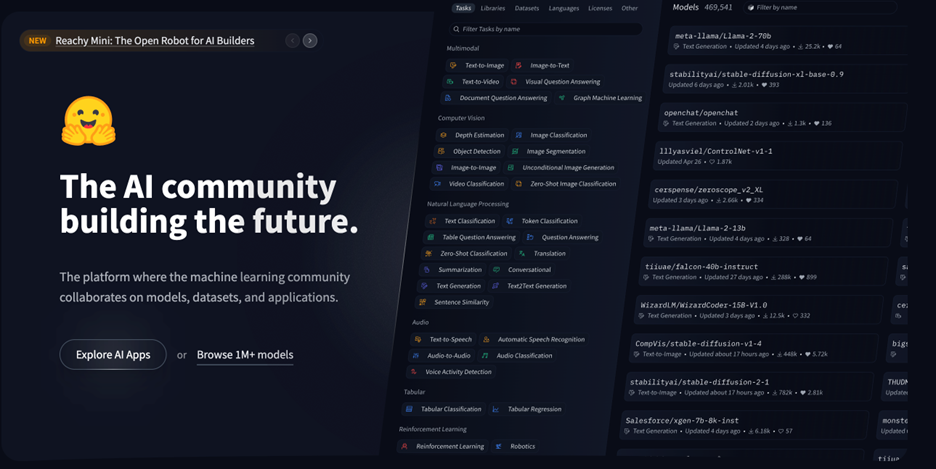

Komponen Utama dalam Ekosistem Hugging Face

- Transformers: Library inti untuk memanggil dan melatih model NLP bahkan vision, termasuk dukungan method penting seperti AutoModel dan AutoTokenizer.

- Datasets: Modul yang mempermudah akses ke ribuan dataset publik, termasuk pre-processing, mapping, hingga streaming data.

- Tokenizers: Library untuk tokenisasi cepat dan kompatibel dengan berbagai model transformer modern.

- Hugging Face Hub: Platform terpusat untuk berbagi model, dataset, dan dokumentasi.

- Spaces: Layanan hosting gratis untuk demo AI berbasis Gradio dan Streamlit.

- Inference API: Layanan inference berbasis cloud untuk akses cepat tanpa instalasi lokal.

Manfaat Hugging Face di Dunia Nyata

Hugging Face telah dipakai di berbagai sektor industri dan penelitian. Contohnya, menurut case study AWS & Hugging Face, perusahaan-perusahaan dapat melatih dan menjalankan model LLM di cloud dengan sangat efisien. Dalam skala kecil, mahasiswa atau developer juga bisa membangun personal assistant, sistem rekomendasi, hingga chatbot hanya dengan model pre-trained dari Hugging Face.

Beberapa manfaat nyata yang dirasakan pengguna:

- Akses instan ke ribuan model tanpa konfigurasi rumit.

- Dukungan komunitas dan dokumentasi yang kuat.

- Fleksibilitas untuk dipakai di lokal maupun cloud.

- Skalabilitas: dari eksperimen kecil di laptop sampai deployment enterprise di cloud.

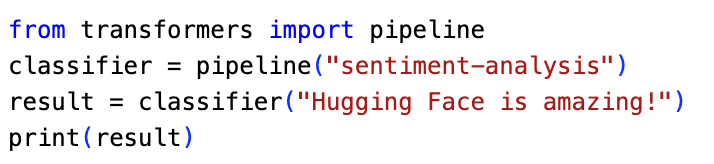

Cara Cepat Menggunakan Model Hugging Face

Untuk pemula, berikut contoh paling sederhana untuk menggunakan model sentiment analysis dari Hugging Face:

Sumber: Hugging Face

Kode ini akan secara otomatis mengambil model distilbert-base-uncased-finetuned-sst-2-english dari Hub dan menjalankan analisis sentimen tanpa kamu harus mengatur arsitektur, weight, atau preprocessing.

Kesimpulan

Hugging Face memberikan pengaruh yang sangat luar biasa pada perkembangan teknolog, khususnya AI. Dari hanya sekadar library kecil untuk NLP, sekarang ia tumbuh menjadi ekosistem AI open-source yang dipakai oleh jutaan developer dan peneliti di seluruh dunia. Lewat berbagai fitur dan komunitasnya yang besar, platform ini bisa jadi titik awal yang bagus buat siapa pun yang ingin mulai ngoding AI tanpa harus dengan coding arsitektur AI yang kompleks.

Oleh: Muhammad Alfhi Saputra

Referensi:

- https://huggingface.co/blog

- https://huggingface.co/docs

- https://towardsdatascience.com/getting-started-with-hugging-face-transformers-in-2023-d69f94d0554c

- https://www.ibm.com/think/topics/hugging-face