Jejak Kecerdasan Buatan Menuju Nobel: John Hopfield dan Geoffrey Hinton, Pelopor Neural Network yang Mengubah Dunia

Pendahuluan

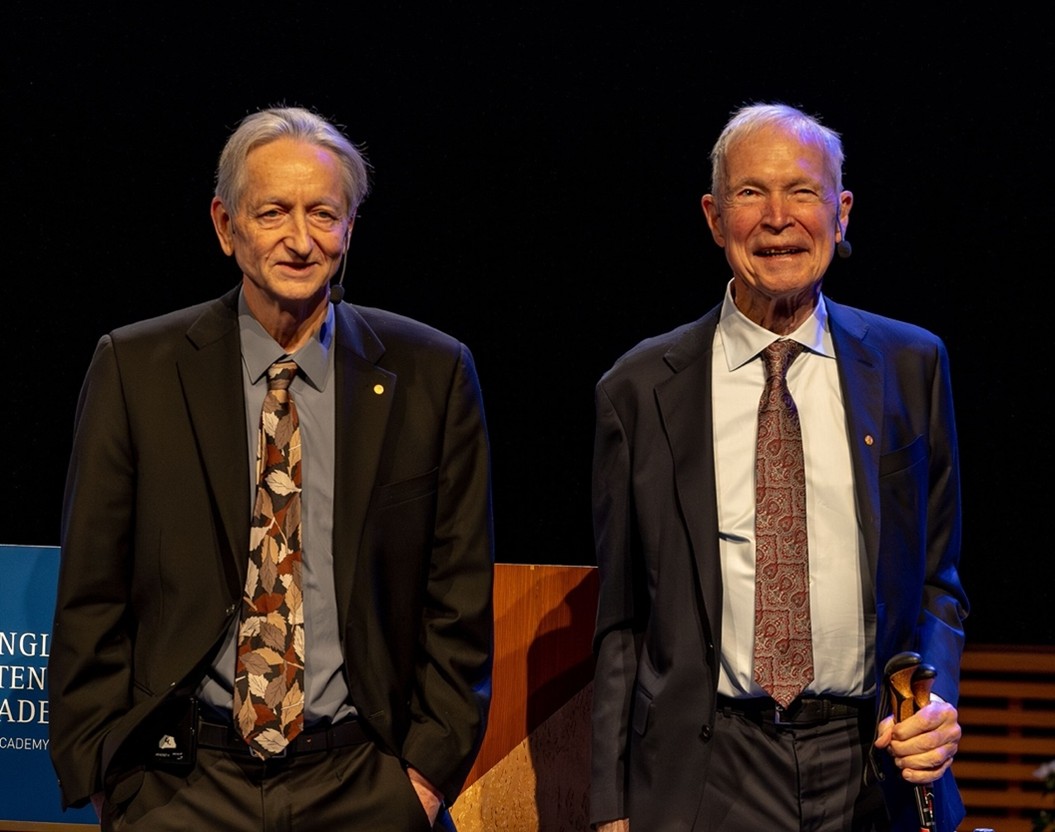

Tahun 2024 menjadi tonggak bersejarah bagi dunia kecerdasan buatan (AI). Untuk pertama kalinya, Penghargaan Nobel Fisika diberikan kepada dua ilmuwan yang karyanya tidak hanya berakar dari fisika teoretis, tetapi juga membentuk dasar teknologi AI modern yang kita gunakan saat ini. Mereka adalah John J. Hopfield dan Geoffrey E. Hinton, dua tokoh yang menemukan dan mengembangkan konsep fundamental dalam artificial neural networks atau jaringan syaraf buatan.

Komite Nobel menyatakan penghargaan ini diberikan “atas penemuan yang membuka jalan bagi mesin untuk belajar dengan meniru cara kerja otak manusia.” (nobelprize.org, 2024)

Melalui karya mereka, Hopfield dan Hinton telah membangun fondasi yang menjadikan pembelajaran mesin modern—terutama deep learning—mampu mencapai performa luar biasa dalam memahami bahasa, gambar, dan bahkan kreativitas.

Source : https://commons.wikimedia.org/wiki/File:John_J._Hopfield_and_Geoffrey_E._Hinton,_2024_Nobel_Prize_Laureate_in_Physics.jpg

John J. Hopfield: Fisikawan yang Mengubah Otak Menjadi Persamaan Energi

John J. Hopfield lahir pada tahun 1933 di Chicago, Amerika Serikat. Ia memulai kariernya sebagai fisikawan teoretis sebelum menaruh minat pada cara kerja otak dan pemrosesan informasi biologis. Pada tahun 1982, Hopfield memperkenalkan Hopfield Network, model yang merevolusi cara ilmuwan memahami memori dan asosiasi dalam sistem saraf buatan.

Hopfield menggunakan konsep dari fisika energi minimum untuk menjelaskan cara jaringan menyimpan dan mengingat pola. Dalam model ini, setiap neuron dihubungkan dengan neuron lain, dan sistem akan “menemukan” kondisi stabil (energi terendah) yang merepresentasikan pola memori yang disimpan.

Model Hopfield menjadi dasar bagi:

- pengembangan sistem autoassociative memory,

- teori pembelajaran berbasis energi minimum, dan

- hubungan antara fisika statistik dan komputasi neuron.

Hopfield menunjukkan bahwa prinsip-prinsip fisika klasik seperti energi dan stabilitas dapat menjelaskan bagaimana sistem biologis (dan buatan) “berpikir”. Kontribusi ini menginspirasi banyak model generatif dan probabilistik di kemudian hari, termasuk Boltzmann Machine milik Hinton.

Geoffrey E. Hinton: Arsitek Deep Learning

Geoffrey E. Hinton, lahir di London pada tahun 1947, dikenal sebagai “Godfather of Deep Learning”. Ia merupakan profesor emeritus di University of Toronto dan peneliti senior di Google DeepMind.

Pada awal kariernya, Hinton memperluas gagasan Hopfield dan memperkenalkan Boltzmann Machine (1985), model jaringan syaraf yang mampu belajar representasi probabilistik dari data. Bersama David Ackley dan Terrence Sejnowski, Hinton menggunakan prinsip fisika statistik untuk menjelaskan bagaimana neuron buatan dapat “belajar” melalui dinamika energi dan distribusi probabilitas.

Selain itu, Hinton berperan besar dalam:

- memopulerkan algoritma backpropagation (1986) bersama Rumelhart dan Williams, yang memungkinkan pelatihan jaringan syaraf berlapis (multi-layer neural networks),

- memperkenalkan Deep Belief Networks (DBN) pada 2006, yang membuka jalan menuju deep learning modern,

- serta mengembangkan konsep representation learning, yaitu kemampuan model untuk membentuk pemahaman internal terhadap data tanpa aturan eksplisit.

Karya Hinton membentuk fondasi bagi model seperti BERT, GPT, dan sistem AI modern yang digunakan di berbagai bidang—dari kesehatan hingga otomotif.

Warisan Bersama: Dari Fisika ke Kecerdasan Buatan

Baik Hopfield maupun Hinton memanfaatkan prinsip-prinsip fisika energi dan probabilitas untuk menjelaskan fenomena pembelajaran mesin.

- Hopfield mengajarkan bahwa jaringan syaraf adalah sistem energi yang mencari kestabilan.

- Hinton menunjukkan bahwa pembelajaran dapat dipandang sebagai proses probabilistik yang menyesuaikan distribusi internal dengan realitas data.

Keduanya membangun jembatan antara fisika, biologi, dan informatika—sebuah perpaduan disiplin yang kini menjadi inti dari revolusi AI.

Dampak terhadap Dunia Modern

Karya Hopfield dan Hinton bukan sekadar teori akademik; mereka telah mengubah cara manusia berinteraksi dengan teknologi.

- Siri, ChatGPT, Google Translate, dan Tesla Autopilot bekerja dengan prinsip yang berakar dari teori mereka.

- Di bidang medis, model berbasis deep learning mampu mendiagnosis kanker dari citra medis dengan tingkat akurasi yang tinggi.

- Di sains murni, teknik jaringan syaraf digunakan untuk memodelkan protein, memprediksi cuaca ekstrem, dan bahkan memahami struktur galaksi.

Penghargaan Nobel ini menjadi pengakuan bahwa kecerdasan buatan bukan hanya cabang teknologi, tetapi juga penemuan ilmiah mendasar tentang cara alam dan otak manusia memproses informasi.

Kesimpulan

John Hopfield dan Geoffrey Hinton bukan hanya dua ilmuwan; mereka adalah penghubung antara fisika dan kecerdasan. Karya mereka membuktikan bahwa pemahaman tentang alam melalui energi, dinamika, dan probabilitas dapat diterjemahkan menjadi mesin yang mampu “berpikir”. Penganugerahan Nobel Fisika 2024 kepada mereka menjadi bukti bahwa AI telah bertransformasi dari alat komputasi menjadi disiplin ilmiah sejajar dengan fisika dan biologi. Dari memori asosiatif hingga deep learning, kontribusi keduanya akan terus menjadi fondasi bagi generasi ilmuwan dan insinyur masa depan.

Penulis

Fiqri Ramadhan Tambunan S.Kom., M.Kom – FDP Scholar

Referensi

- Nobel Prize Committee. (2024). The Nobel Prize in Physics 2024 – Press Release. https://www.nobelprize.org/prizes/physics/2024/press-release

- Nobel Prize Committee. (2024). Facts on the Nobel Prize in Physics 2024 – John J. Hopfield. https://www.nobelprize.org/prizes/physics/2024/hopfield/facts

- Nobel Prize Committee. (2024). Facts on the Nobel Prize in Physics 2024 – Geoffrey E. Hinton. https://www.nobelprize.org/prizes/physics/2024/hinton/facts

- Ackley, D. H., Hinton, G. E., & Sejnowski, T. J. (1985). A Learning Algorithm for Boltzmann Machines. Cognitive Science, 9(1), 147–169.

- Hopfield, J. J. (1982). Neural networks and physical systems with emergent collective computational abilities. Proceedings of the National Academy of Sciences (PNAS), 79(8), 2554–2558.

- Hinton, G. E., Rumelhart, D. E., & Williams, R. J. (1986). Learning representations by back-propagating errors. Nature, 323(6088), 533–536.

- Nature Editorial. (2024). Nobel Prize recognises pioneers of neural network physics. Nature, 625, 441–442.

- Science Magazine. (2024). From energy functions to deep learning: the Nobel physics of artificial brains. Science, 386(6710), 901–903.