Ngefans dengan Idol VTuber? Inilah Teknologi Dibaliknya

Gambar 1. Hoshimachi Suisei konser di Nippon Budokan, Tokyo (https://x.com/suisei_hosimati)

Gambar 1. Hoshimachi Suisei konser di Nippon Budokan, Tokyo (https://x.com/suisei_hosimati)

VTuber atau Virtual YouTuber kini telah menjadi fenomena global. Di balik keseruan karakter animasi yang berbicara, tertawa, dan berinteraksi, terdapat teknologi kompleks yang memungkinkan realisme dan responsivitas tinggi. Artikel ini mencoba untuk mempelajari elemen-elemen teknis seperti face tracking, real time lip sync, rigging, hingga motion capture yang menyatukan manusia dan avatar virtual secara mulus.

Sistem face tracking Menjadi Hati dari Interaksi Vtuber

Salah satu komponen paling krusial adalah sistem face tracking. Untuk menangkap ekspresi sdari manusia dibalik VTuber, sering kali menggunakan webcam atau kamera dengan kemampuan 3-D, seperti iPhone dengan Face ID. Perangkat ini mengukur orientasi kepala, gerakan bibir, alis, dan sudut mata secara real time dan menerjemahkannya ke avatar digital. Perangkat lunak seperti VTube Studio telah menjadi andalan VTuber Live2D. Aplikasi ini mampu membaca data ekspresi wajah dari webcam atau iPhone dan mengubahnya menjadi parameter rig di avatar 2D secara real time. Untuk VTuber 3D, kombinasi software seperti iFacialMocap dan LiveLink Face (Unreal) juga digunakan untuk mendapatkan tracking ekspresi yang lebih presisi. SDK seperti Visage SDK juga menjadi salah satu teknologi dasar dalam face tracking. Visage SDK menawarkan pelacakan kepala secara 3D, landmark pada wajah, dan gerakan mata sehingga data dari kamera bisa diubah menjadi informasi pose yang dapat dipetakan ke dalam model digital.

Real Time Lip Sync

Bagian lain yang tak kalah penting adalah lip sync real time. Teknologi ini memungkinkan avatar membuka dan menutup mulut sesuai dengan suara pembicara dalam waktu sangat singkat. Ada dua metode utama: analisis audio dan pelacakan wajah. Metode berbasis audio bekerja dengan memecah suara ke dalam fonem (unit suara) dan kemudian memetakan fonem tersebut ke viseme yaitu bentuk mulut dari avatar. Cara ini cukup efisien dan tidak butuh kamera. Namun, ia cenderung kurang ekspresif. Sedangkan metode berbasis kamera menganalisis landmark wajah (misalnya sudut mulut, rahang, bibir) secara langsung dan menerapkan data tersebut ke rig avatar. Hal ini menghasilkan sinkronisasi mulut yang lebih natural dan realistis karena mengikuti ekspresi wajah pengguna secara akurat. Rigging wajah dari karakter virtual sangatlah berperan. Pada model 2D (Live2D), rigger menetapkan parameter untuk berbagai bentuk mulut dan ekspresi agar data viseme atau ekspresi bisa diterjemahkan dengan halus. Sedangkan di model 3D, biasanya digunakan blend-shape (morph target) atau tulang wajah untuk menggerakkan ekspresi sesuai input dari sistem tracking yang digunakan.

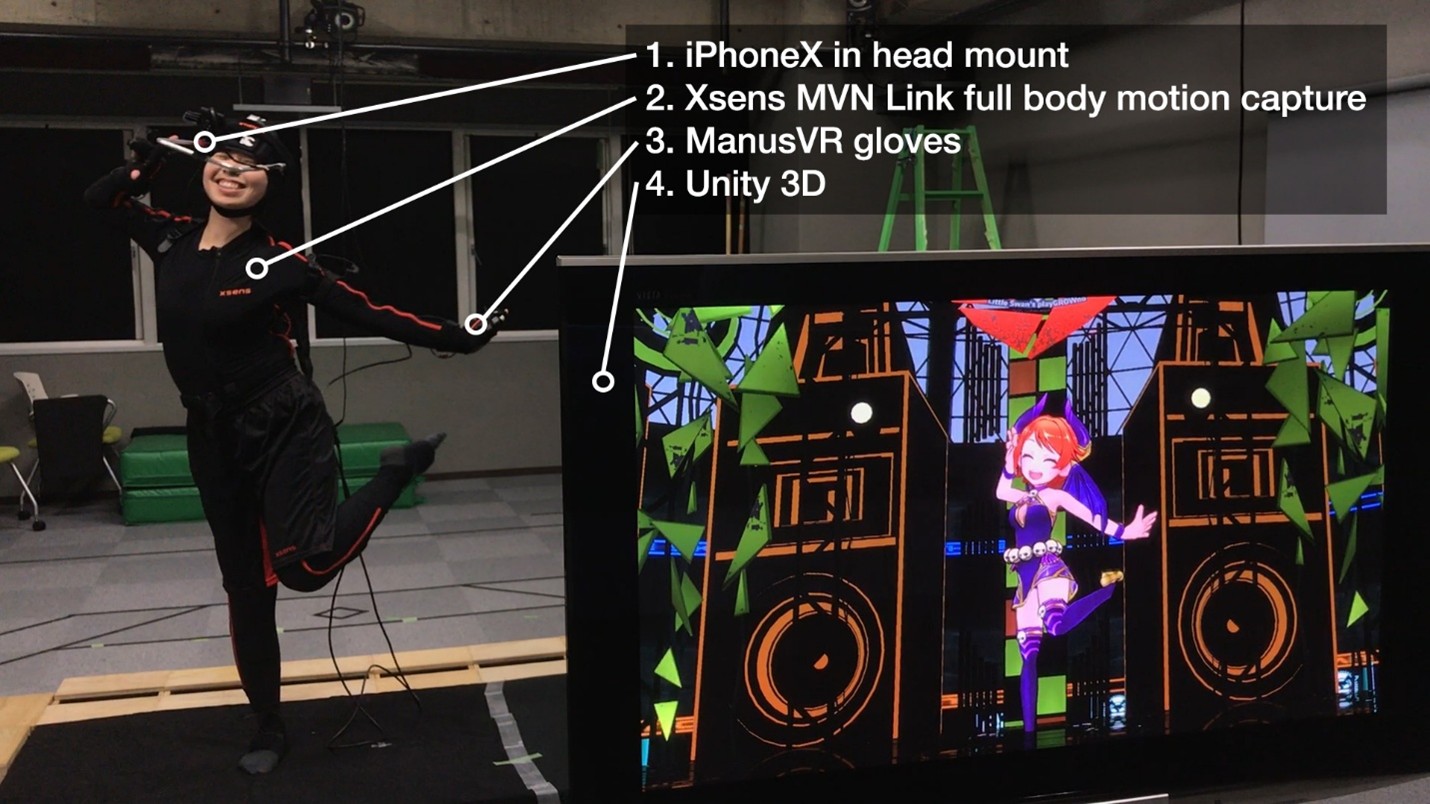

Gambar 2. Teknologi dibalik Vtuber (https://www.movella.com/resources/blog/virtual-youtuber)

Avatar dan Rigging

Avatar VTuber biasanya dibuat dari dua jenis model: Live2D 2D dan 3D VRM. Live2D memungkinkan animator mengubah gambar 2D menjadi karakter bergerak dengan membagi objek gambar menjadi lapisan-lapisan (misalnya rambut, mata, mulut), lalu melakukan rigging pada karakter virtual agar bisa digerakkan. Sementara itu, model 3D dibuat dengan menggunakan alat seperti VRoid Studio untuk menciptakan karakter dengan rig berbasis skeleton, blend-shape, dan tekstur yang kompleks. Setelah rig wajah dan tubuh selesai, data tracking dan input ekspresi dari pengguna dapat langsung menggerakkan avatar secara real time.

Gambar 3. Konser pertama Hololive ID di ICE BSD, Tangerang (https://x.com/hololive_Id)

Motion Capture

Tidak hanya wajah, beberapa VTuber menggunakan motion capture baik berupa optik seperti kamera maupun inersial. Teknologi inersial (IMU) memakai sensor seperti akselerometer dan giroskop yang melekat di badan untuk menangkap gerakan tubuh secara real time. Untuk kebutuhan yang lebih profesional, suit mocap seperti yang dibuat Rokoko dapat menangkap gerakan tubuh lengkap dan jari sehingga avatar bisa menari, berjalan, atau berakting seperti manusia. Teknologi ini memungkinkan VTuber menampilkan koreografi dan emosi tubuh secara lebih realistis.

Kesimpulan

Teknologi di balik VTuber adalah kombinasi rumit antara face tracking, real time lip sync, rigging, dan motion capture. Semua elemen ini bekerja bersama secara real time untuk menciptakan avatar virtual yang terasa hidup, ekspresif, dan responsif. Tanpa teknologi ini, VTuber hanyalah karakter yang statis dan tidak dapat bergerak, akan tetapi dengan teknologi ini, mereka menjadi jembatan antara identitas manusia dan avatar virtual yang dicintai oleh penggemarnya.

Bagi calon VTuber, meskipun ada banyak opsi alat dan software, memahami teknologi dasar ini sangat penting. Dari webcam sederhana hingga suit mocap canggih, pilihan setup tergantung pada skala konten dan ambisi kreatif. Di masa depan, teknologi VTubing diprediksi akan semakin maju, dengan integrasi AI, tracking lebih halus, dan pergerakan avatar yang akan semakin realistis.

Penulis

Daniel Kevin Jhon Feko Wahyudi, S.Kom – FDP Scholar

Referensi

How Face Tracking Works in VTubing And Why It Matters? VtuberLab. (2025, June 09). Retrieved from https://vtuberlab.com/2025/06/09/how-face-tracking-works-in-vtubing-and-why-it-matters/

The Science Behind Real-Time Lip Syncing in VTubing. VtuberLab. (2025, June 16). Retrieved from https://vtuberlab.com/2025/06/16/the-science-behind-real-time-lip-syncing-in-vtubing/

Top VTuber Tools in 2025: Which Software Fits Your Needs? VtuberLab. (2025, June 13). Retrieved from https://vtuberlab.com/2025/06/13/top-vtuber-tools-in-2025-which-software-fits-your-needs/

Andi Nabiilah Nur Ashiilah. (2024, September 18). Ini Dia Aplikasi Wajib untuk Kamu yang Ingin Menjadi VTuber. Teknologi.id. Retrieved from https://teknologi.id/insight/ini-dia-aplikasi-wajib-untuk-kamu-yang-ingin-menjadi-vtuber

Jun Ling, Xu Tan, Liyang Chen, Runnan Li, Yuchao Zhang, Sheng Zhao, Li Song. (2022). StableFace: Analyzing and Improving Motion Stability for Talking Face Generation. arXiv. Retrieved from https://arxiv.org/abs/2208.13717